百度文心ERNIE 5.0 AI模型以多模态能力突破新境界

百度通过ERNIE 5.0发布将AI推向新高度

在人工智能领域的重大飞跃中,百度推出了ERNIE 5.0,这是其迄今为止最新、最复杂的AI模型。这一版本的独特之处在于?通过创新的统一建模技术,能够无缝处理和整合多种数据类型——文本、图像、音频和视频。

数据解析

ERNIE 5.0的巨大规模引人注目:

- 2.4万亿参数为其运行提供动力

- 不到3%的激活参数比例确保高效性能

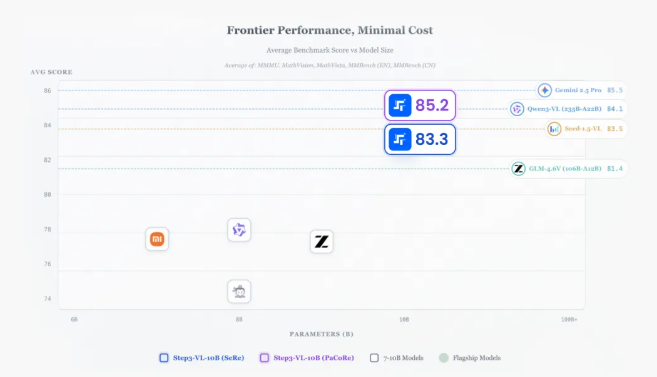

- 在超过40项基准测试中排名前列,超越了Gemini-2.5-Pro和GPT-5-High等模型

"我们不仅仅是在追求参数数量,"百度首席AI科学家李伟博士解释道。"真正的突破在于ERNIE 5.0如何高效利用其架构,同时提供卓越的结果。"

多模态掌控力

与之前单一焦点的模型不同,ERNIE 5.0擅长处理复杂性:

- 同时分析不同的媒体格式

- 在多模态间保持上下文以获得更丰富的理解

- 通过连接视觉和文本线索提供更细致的响应

想象一下口头描述一幅画的同时展示其视觉图像——这就是ERNIE轻松处理的集成处理能力。

专家调优的性能

开发团队招募了来自金融、教育和文化等不同领域的835名专家来优化模型的输出:

- 增强了技术领域的逻辑一致性

- 提高了专业内容创作的深度

- 在各种应用中具有更强的文化敏感性

结果如何?一个不仅能回答问题而且理解专业背景的AI助手。

可及的创新

推出策略使这一强大工具面向不同用户:

| 用户类型 | 访问方式 |

|---|

公司预计广泛的采用将推动从医疗保健到创意领域等各行业的数字化转型。

关键点:

- 多模态集成:同时处理文本、图像、音频和视频

- 高效架构:大规模而不牺牲速度或成本效益

- 领域专业知识:数百名专家贡献了专业知识领域

- 广泛可及性:通过多个平台满足不同用户需求