苹果SlowFast-LLaVA模型在长视频分析中表现卓越

苹果SlowFast-LLaVA模型创视频理解新标杆

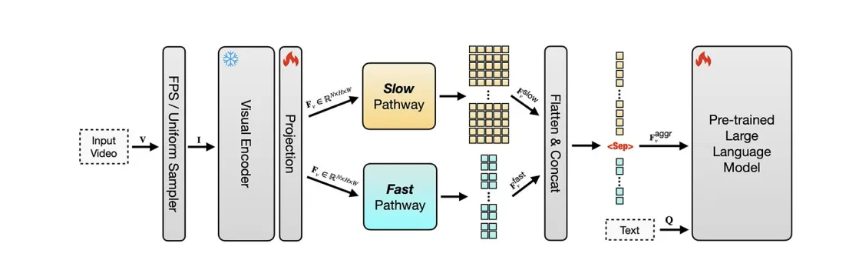

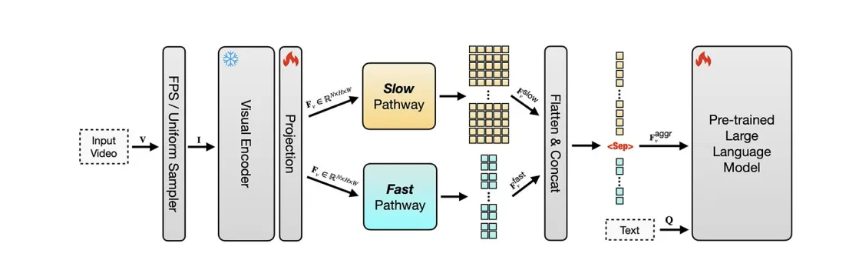

苹果研究团队推出的SlowFast-LLaVA是一项突破性模型适配方案,在长视频分析任务中展现出卓越性能。最新报告显示,这一创新在效率和准确性上甚至超越更大规模模型,为处理长时间视频内容提供了强大解决方案。

双流架构:高效处理的关键

该模型的成功在于其双流架构设计,有效解决了信息冗余和上下文窗口溢出等常见挑战。

- 慢速流:以低帧率运行,捕捉静态细节和背景信息。

- 快速流:以高帧率追踪快速动作变化。

这种协作方式在保持高准确性的同时优化了处理效率。

性能指标:超越大型模型

在基准测试中,SlowFast-LLaVA在不同参数规模下均取得显著成果:

- 10亿参数版本:在General VideoQA(LongVideoBench)获得56.6分。

- 70亿参数版本:在长视频理解任务中达到71.5分。

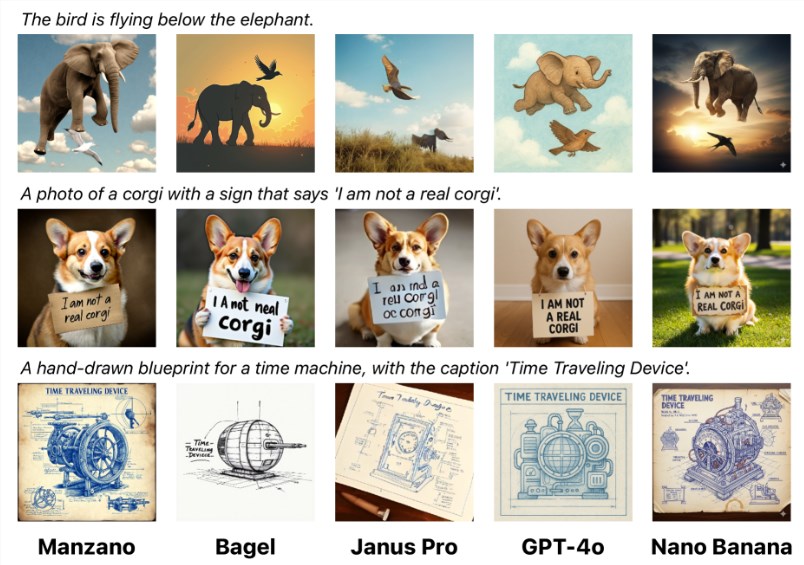

该模型还擅长图像理解任务,包括知识推理和OCR识别,展现出多功能的特性。

局限性与未来改进

尽管成就显著,该模型目前最多支持128帧输入,可能导致更长视频中的关键信息遗漏。苹果团队承诺将改进内存优化技术以进一步提升性能。

开源贡献

该模型基于公开数据集训练并已开源,为AI社区推进长视频理解技术提供了强大工具。

核心要点:

- 双流设计优化视频处理效率。

- 基准测试表现优于更大规模模型。

- 开源特性促进社区创新。

- 当前限制包括128帧输入上限。

- 未来更新将聚焦内存优化。