蚂蚁集团LingBot-VLA为机械臂赋予类人精准度

蚂蚁集团为机械臂升级"AI大脑"

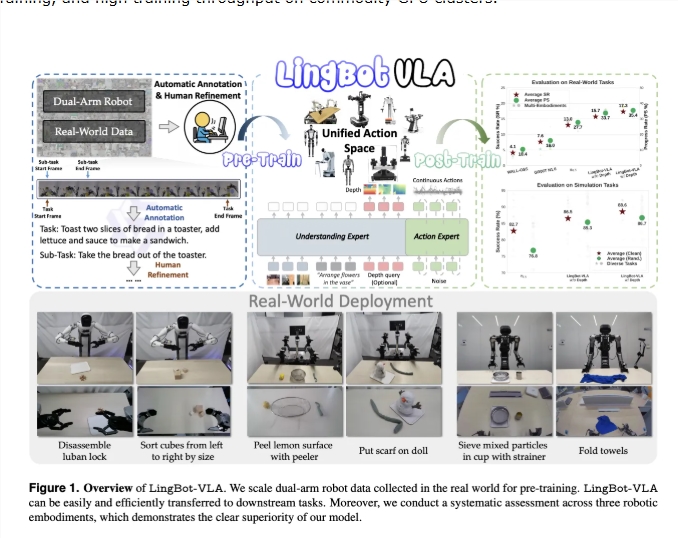

在机器人灵巧性领域的重大突破中,蚂蚁集团推出LingBot-VLA人工智能系统,为机械臂带来类人的精确控制能力。这不仅是一次渐进式改进,更可能彻底改变工厂、仓库等需要精细操作机器人的场景。

教会机器人"触觉艺术"

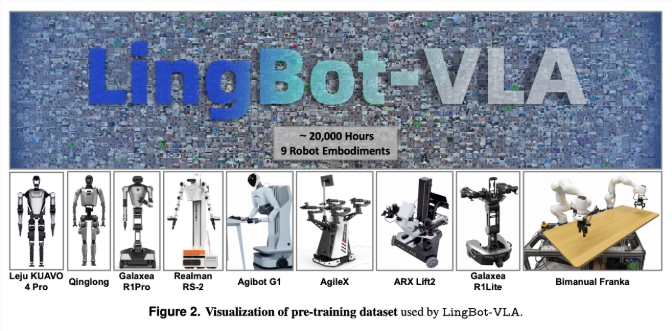

成功秘诀?海量真实世界训练。研究人员采集了约2万小时九种不同双臂机器人的远程操作数据——相当于人类不间断练习两年多。这些并非简单动作,数据集捕捉了复杂任务所需的精妙操作序列。

"想象通过YouTube视频教人跳芭蕾舞",项目首席研究员李伟博士解释道,"这就是我们对机器人做的事——只不过我们教的是双臂如何完美协同,而非舞蹈步伐"。

工作原理:观察·理解·执行

LingBot-VLA融合三大核心能力:

- 视觉感知:通过Qwen2.5-VL同时处理多角度摄像头数据

- 语言理解:准确解析"将立方体轻放在顶部"等指令

- 动作预测:采用条件流匹配实现流畅连续的运动控制

得益于内置空间推理模块,系统甚至能补偿深度传感器缺失数据——相当于赋予机器人无需持续测量就能感知物体距离的先天能力。

超出预期的实际表现

在包含100项挑战任务的基准测试中:

- 达成17.3%成功率(显著高于竞品)

- 仅需80次演示即可适配新机型

- 在插桩、布料折叠等精细操作中表现突出

这对依赖精密自动化的行业意义重大。在当前系统常受困于现实环境不可预测性的情况下,LingBot-VLA展现出非凡的适应能力。

开启机器人研究新纪元

这项可能加速全领域创新的意外举措包括:

- 完整训练工具包现已开源

- GPU集群优化(训练速度达替代方案的1.5-2.8倍)

- 向全球研究者开放完整模型权重

这种先进机器人AI技术的民主化或将大幅降低应用门槛——从辅助生活设施到灾难救援机器人都有望迎来爆发式应用。

核心亮点:

- 双臂协同:实现单臂无法完成的复杂操控任务

- 快速适应:通过少量演示数据即可学习新机型

- 深度感知:即使没有传感器也能保持空间意识

- 开放生态:公开释放可能推动广泛采用与创新