阿里开源新AI模型:小巧身躯蕴含强大编程能力

阿里发布高效AI模型助力下一代编程

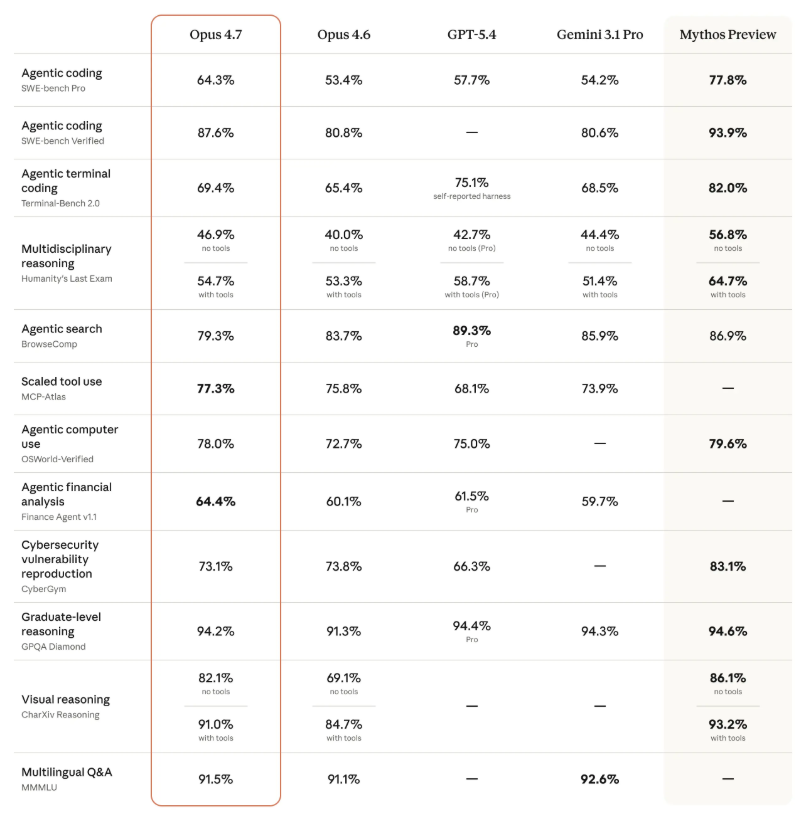

阿里Qwen团队开源Qwen3.6-35B-A3B的举措或将重塑开发者构建AI应用的方式。这不仅是又一个大型语言模型——更是通过精密工程实现卓越效率且不牺牲性能的系统。

更智能而非更费力:MoE架构优势

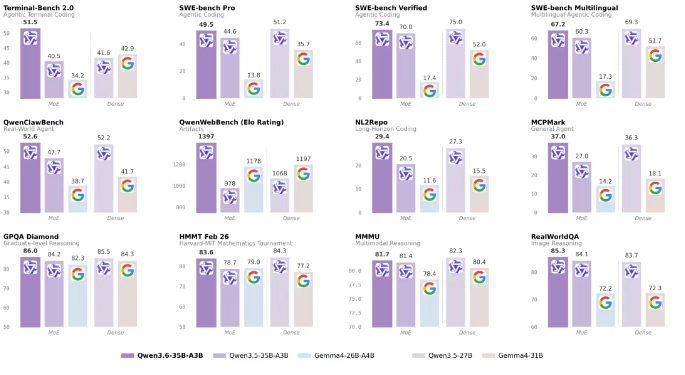

该模型的特别之处?其稀疏专家混合(MoE)架构在运行时仅激活350亿总参数中的30亿。就像拥有一支专家团队,每个任务只调用合适的专家。这种智能方式使模型具备:

- 优于270亿参数Qwen3.5-27B的性能表现

- 较前代Qwen3.5-35B-A3B的显著提升

- 推理与协作能力可媲美Gemma4-31B等更大模型

不止于代码

虽然编程能力是核心亮点,Qwen3.6-35B-A3B的视觉理解同样令人惊喜。在RefCOCO测试中获得92.0分,其空间智能接近Claude Sonnet4.5等商业模型。这种多模态能力为结合代码与视觉元素的应用开启新可能。

即装即用

开发者现已可通过Qwen Studio或阿里云百炼平台(寻找qwen3.6-flash API)使用该模型。它能流畅配合OpenClaw和Claude Code等主流编程助手,其独特的preserve_thinking功能可在复杂编程任务中保持上下文连贯。

随着AI向边缘设备和专用智能体发展,Qwen3.6-35B-A3B等模型证明:精妙的架构选择无需庞大计算资源,也能实现强大能力。

核心亮点

- 高效设计:350亿总参数但单次仅激活30亿

- 编程利器:编码任务表现超越更大规模模型

- 视觉智能:在空间与视觉理解方面表现优异

- 即刻可用:已集成至Qwen Studio与阿里云服务

- 面向未来:边缘AI与智能体开发的理想选择