AI图像工具被滥用制作非自愿深度伪造内容

AI图像生成器遭利用进行深度伪造滥用

随着AI图像生成工具被武器化用于制作女性非自愿深度伪造图像,主要科技公司面临日益严格的审查。这项始于创意科技的工具已沦为数字剥削的骇人手段。

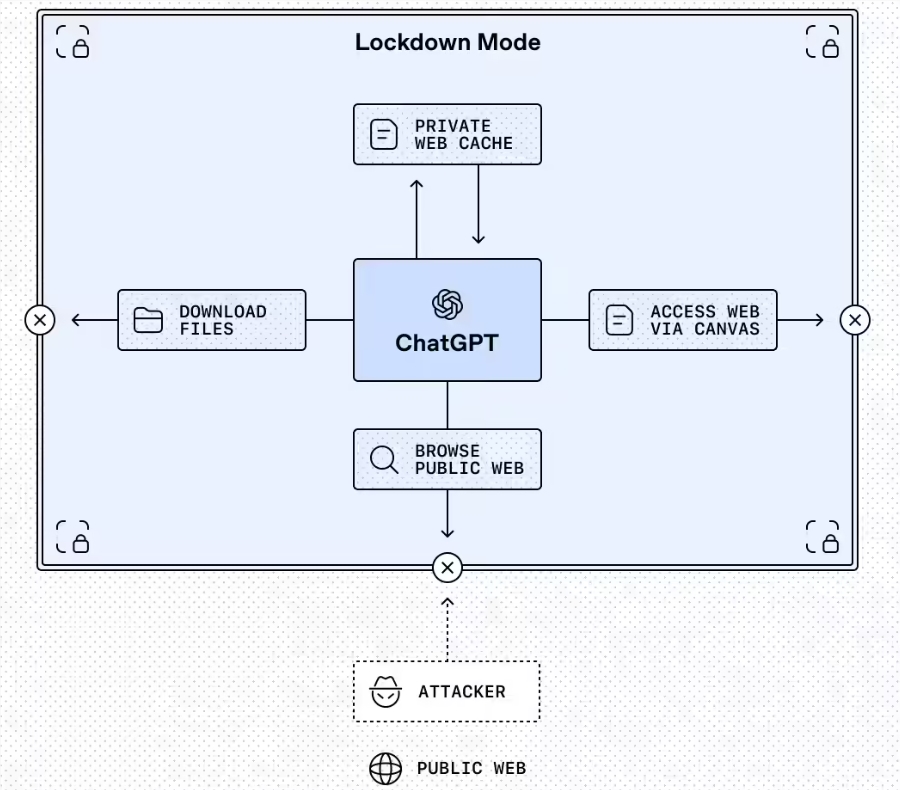

安全措施如何被规避

谷歌Gemini和OpenAI的ChatGPT——本为合法创意用途设计——却在不知情中成为生成虚假露骨内容的帮凶。技术娴熟的用户发现可以通过精心设计的提示词绕过内容过滤器操控这些系统。

在Reddit等平台上,地下社群蓬勃发展,成员们分享照片"去衣"技术。一个臭名昭著的案例涉及将身着印度传统服饰的女性照片修改为泳装照。虽然Reddit最终封禁了这个20万成员的论坛,但损害已然造成——无数篡改图片仍在网络流传。

科技公司的应对

谷歌和OpenAI均承认该问题但面临艰难挑战:

- 谷歌坚持禁止生成露骨内容的严格政策,并表示正持续改进检测系统

- OpenAI今年虽放宽了对非色情成人图像的限制,但严禁未经授权的肖像修改

两家公司强调正对违规账户采取行动,但批评者认为被动措施远远不够。

超逼真伪造品的日益增长威胁

随着AI技术呈指数级进步,情况持续恶化:

- 谷歌新款Nano Banana Pro展现出惊人的真实感

- OpenAI最新图像模型生成的伪造品几乎难辨真假 法律专家警告这些进步危险地降低了制造可信虚假信息的门槛。

核心挑战依然存在:科技巨头如何平衡创新与伦理责任?随着AI能力日趋复杂,防止滥用的保护措施也必须同步升级。

关键要点:

- 当前AI图像生成器存在允许不当修改的安全漏洞

- 地下社群积极分享规避防护措施的技巧

- 平台响应仍主要停留在事后处理而非预防

- 随着技术进步,超逼真伪造品构成日益严重的威胁

- 关于负责任AI开发的伦理困境不断加剧