Adobe和麻省理工学院推出CausVid,一种革命性的实时视频生成模型

Adobe和麻省理工学院推出CausVid,一种革命性的实时视频生成模型

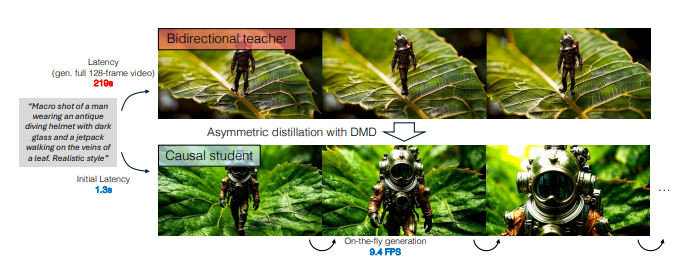

Adobe和麻省理工学院合作推出CausVid,这是一种尖端的视频生成模型,显著提高了视频创作的速度和效率。CausVid的首帧延迟仅为1.3秒,生成速度为每秒9.4帧,在实时视频生成领域代表了一个显著的飞跃。

克服视频生成中的传统限制

传统的视频生成模型通常存在速度慢的问题。这些模型在渲染每一帧之前会分析整个视频序列,导致需要数分钟甚至数小时才能完成的长延迟。这对于需要快速反馈和实时互动的行业,如游戏和虚拟现实,尤其成为一个问题。

然而,CausVid通过利用一种新颖的因果生成方法提供了革命性的解决方案。CausVid并不是处理整个序列,而是通过分析已经生成的帧来预测下一帧。这种方法减少了计算开销,并且使视频生成速度大幅提升。

CausVid快速速度背后的科学

那么,CausVid是如何实现这一突破的呢?答案在于非对称蒸馏技术。研究人员首先训练了一个双向扩散模型,能够生成高质量视频,但速度较慢。然后,他们将该模型的知识转移到CausVid,使其能够以惊人的速度预测下一帧。

此外,像ODE初始化和KV缓存等技术也被实施,以进一步优化模型在训练和推理过程中的性能。这些创新确保CausVid不仅运行更快,而且在操作过程中保持稳定。

一个强大且多功能的视频生成工具

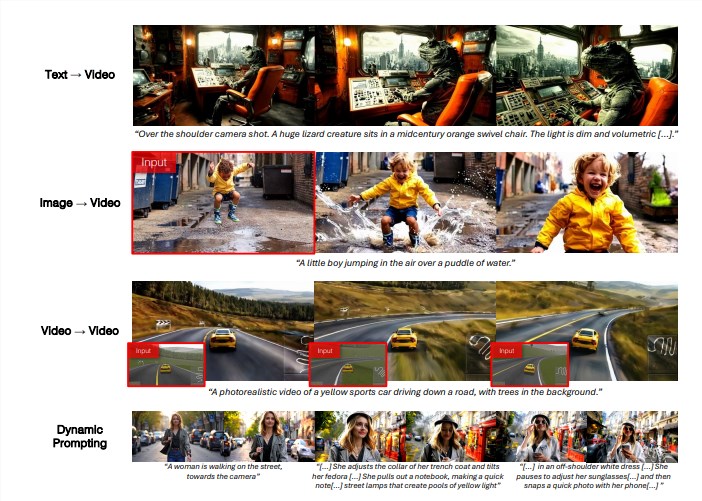

CausVid不仅快速,而且非常多功能。它支持各种视频生成任务,包括文本转视频、图像转视频、视频转视频转换和动态提示。每个任务都可以以极低的延迟完成,为实时应用提供了巨大潜力。

该模型快速高效的生成视频的能力开辟了从游戏到虚拟现实和流媒体等多个领域的激动人心的可能性。想象一下能够实时生成动态游戏场景,甚至用语音命令和动作创建自定义视频内容。CausVid的潜在应用广泛,这个模型有望重新定义视频内容的创作和消费方式。

CausVid的开发标志着视频生成领域的重大突破,承诺带来实时互动和一系列新能力,供行业和创作者使用。

有关CausVid的更多信息,请访问官方网站项目页面:https://causvid.github.io/

关键点

- CausVid的首帧延迟仅为1.3秒,视频生成速度为每秒9.4帧。

- 该模型使用因果生成方法预测下一帧,减少计算开销。

- 非对称蒸馏、ODE初始化和KV缓存是实现CausVid速度和稳定性的关键技术。

- CausVid支持文本转视频、图像转视频和视频转视频转换,延迟极低。

- 该模型承诺通过实现实时视频创作来革命化游戏、虚拟现实和流媒体等行业。