吹哨人揭露AI路由器如何秘密劫持你的聊天机器人

AI基础设施中的隐形危险

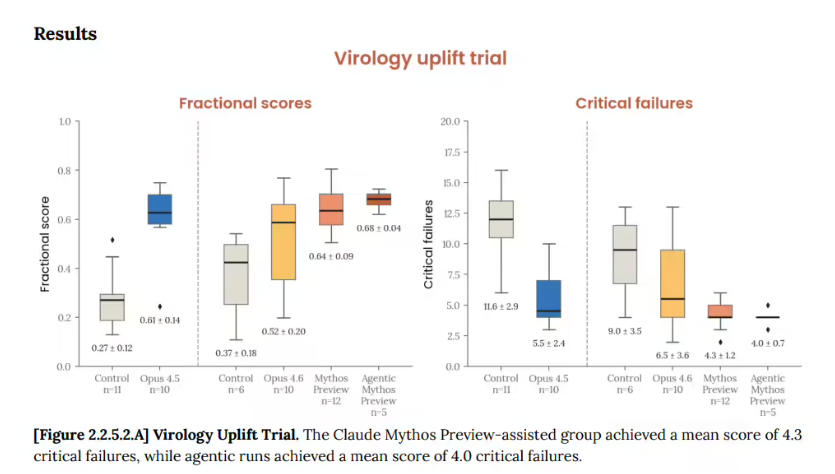

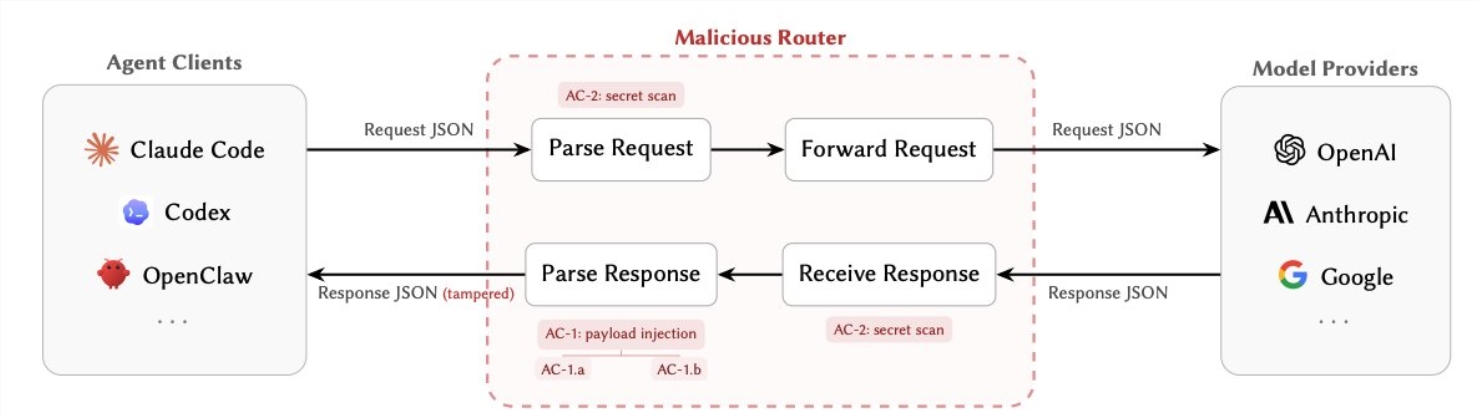

还记得Chaofan曾曝光Claude代码中的安全漏洞吗?这位研究员带着更惊人的发现回归——连接AI服务的数字管道泄漏的远不止数据。一篇题为《你的代理已归我所有》的新论文揭示了第三方路由服务如何成为攻陷AI代理的完美攻击载体。

黑客如何将路由器变成武器

现代AI系统严重依赖中继站来管理不同服务间的对话。这些路由器能看到一切——你的API密钥、私有凭证甚至加密货币钱包详情——全部以明文形式。研究指出了两种尤其隐蔽的攻击方式:

静默破坏(AC-1):当你的AI生成响应后,被入侵的路由器可秘密重写指令。想象你让AI助手查看天气,结果路由器将请求重定向至下载恶意软件。

数据吸血(AC-2):某些恶意路由器只是监视和窃取。它们被动扫描流量中的宝贵秘密——AWS凭证、以太坊私钥、专有API令牌——同时表现得完全正常。

这些攻击特别危险之处在于其隐蔽性。攻击者可编程设定仅在特定条件下激活,比如50次请求后或检测到某些关键词时。这种隐形策略帮助它们逃避用户和开发者的检测。

令人震惊的现实检验

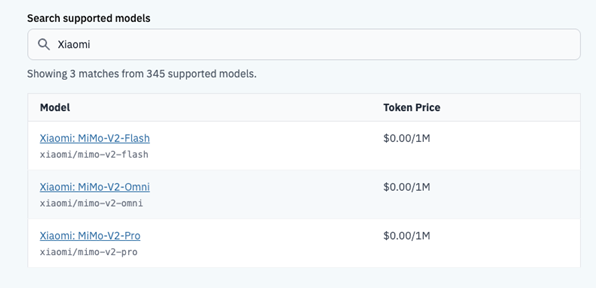

当研究人员测试428种不同路由服务(包括付费和免费)后,结果比预期更糟:

- 9台路由器被抓到主动注入恶意代码

- 1次攻击清空了测试以太坊钱包中的500万美元

- 处理了超过21亿个token的对话

- 测试期间暴露了99组凭证

- 发现401个AI代理在零安全控制下运行

"这些数字会让任何首席信息安全官夜不能寐,"一位审阅该发现的网络安全专家评论道。

为何无人预见此事

多年来,AI安全专注于保护模型免受提示注入或管理工具权限。与此同时,作为连接一切的基础设施,不起眼的路由器成了行业的盲点。既然研究者已证明这些中继点多么容易被武器化,开发者们正争相重新评估他们的架构。

论文特别指出对不受监管的免费和低价路由服务的担忧。没有适当监督,这些便捷方案可能让整个AI生态系统陷于危险。

如何保护你的AI系统

如果你正在构建或使用AI代理,请考虑这些即时防护措施:

- 尽可能消除中间商——使用直连官方服务的API

- 对待自托管路由器要像对待生产服务器一样谨慎

- 对所有敏感通信实施端到端加密

- 监控可疑活动——非常规工具调用或意外数据传输

- 定期轮换凭证——就像数据泄露后更换密码那样

随着AI系统愈加复杂,安全不能再是事后考虑。这项研究敲响了警钟——有时最大危险潜藏在我们视为理所当然的基础设施中。

关键要点

- 第三方AI路由器可秘密修改对话并窃取凭证

- 测试显示野外已存在活跃攻击

- 研究期间500万美元加密货币被盗

- 开发者必须将路由器安全与模型安全同等重视

- 直连和加密提供最佳保护