机器人获得人类触感:突破性数据集弥合感官鸿沟

通过尖端数据集 机器人获得全新触觉

想象一下,机器人能像裁缝般细腻感知布料质地,或如资深服务员般小心处理易碎餐具。随着革命性数据集Baihu-VTouch的发布,这个未来正加速到来——它为机器同时提供了视觉与触觉感知能力。

海量规模与精度的结合

Baihu-VTouch背后的数字令人震撼:

- 9000万+ 真实世界接触样本

- 6万分钟 高分辨率记录

- 120Hz刷新率 捕捉细微触碰

- 640×480分辨率 检测微观纹理

"这不只是数据量的增加——更是质的飞跃",威泰机器人林伟博士解释道:"我们不仅记录机器人所见,更记录了交互过程中物体的真实触感。"

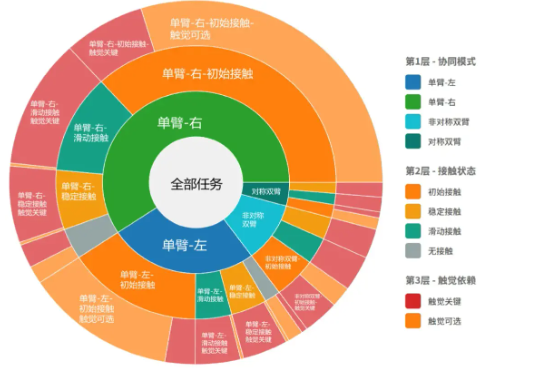

一套数据集适配所有机器人

Baihu-VTouch的真正创新在于其对各类机器人平台的普适性:

- "青龙"等仿人机器人

- 工业用轮式机械臂

- 甚至研究实验室的手持夹爪

这意味着什么?基于该数据集训练的单一AI系统,有望让不同机体的机器人都获得"触觉感知"能力——这将大幅缩短开发周期。

实际应用场景落地

研究人员并未止步于原始数据收集。他们围绕真实场景构建了Baihu-VTouch:

- 家居环境 ——处理精致玻璃器皿或调整湿滑表面的抓握力度

- 餐饮服务 ——感知完美压力以抓取生菜而不压坏它

- 精密制造 ——仅通过触摸检测微观缺陷

- 危险工况 ——在低能见度环境下凭触觉操作工具

早期测试显示,使用该数据的机器人在需要精细力道控制的任务中表现提升68%——有望在未来应用中避免无数物品损坏。

Baihu-VTouch数据集不仅是技术成就,更是让机器人能安全共享人类物理空间、像人一样细心处理日常物品的关键一步。

核心要点:

- 首个跨平台视觉+触觉机器人数据集

- 以前所未有的规模捕捉细微触感

- 实现更具适应性的机器感知系统

- 直接适用于服务业与制造业场景

- 现已面向全球研发开放