北京大学发布LLaVA-o1:一种新的多模态AI模型

北京大学发布LLaVA-o1:一种新的多模态AI模型

最近,北京大学的一个研究团队宣布推出LLaVA-o1,这是一种多模态开源模型,声称是首个能够进行自发和系统性推理的视觉语言模型,类似于GPT-o1。

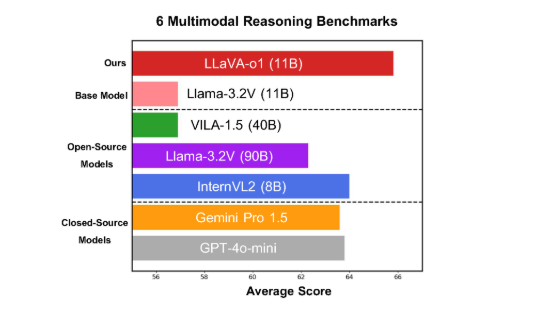

该模型在六项具有挑战性的多模态基准测试中表现出色。其拥有110亿参数的版本超越了包括Gemini-1.5-pro、GPT-4o-mini和Llama-3.2-90B-Vision-Instruct在内的显著竞争对手。

特性与能力

LLaVA-o1基于Llama-3.2-Vision模型构建,并采用独特的“慢思维”推理机制。这使得它能够更复杂的推理过程进行自主推理,这比传统的思维链提示方法有了显著的进步。

在多模态推理基准评估中,LLaVA-o1的表现比其基础模型提高了8.9%。该模型的推理过程分为四个不同的阶段:摘要、视觉解释、逻辑推理和结论生成。传统模型通常表现出相对简单的推理过程,可能导致错误的结论。相反,LLaVA-o1的多步骤推理框架提高了输出的准确性。

例如,在回答问题“去掉所有小的亮球和紫色物体后还剩多少个物体?”时,LLaVA-o1首先对问题进行摘要,从随附的图像中提取相关信息,然后进行详细的逐步推理过程,以得出正确答案。这种分阶段的方法显著增强了模型的系统性推理能力,提高了处理复杂问题的效率。

推理创新

值得注意的是,LLaVA-o1在推理阶段整合了阶段性束搜索方法。这一创新方法使得模型能够在每个推理阶段生成多个候选答案,并选择最佳响应以进入下一个阶段,从而显著提升了其推理的整体质量。通过系统的微调和使用适当的训练数据,LLaVA-o1在与更大或闭源模型相比时显示出显著的性能。

北京大学团队的研究成果有望推动多模态人工智能领域的发展。他们为未来的视觉语言理解模型引入了新思想与方法。团队承诺将完全开源与LLaVA-o1相关的代码、预训练权重和数据集,鼓励AI社区的研究人员和开发者进一步探索和应用。

有关更详细的信息,研究论文可在此处获取,项目的源代码可在GitHub上找到。

要点

- LLaVA-o1是由北京大学团队发布的新多模态推理模型,具有“慢思维”推理能力。

- 该模型在多模态推理基准测试中超越了其基础模型,提升幅度为8.9%。

- LLaVA-o1通过结构化的多步骤推理确保准确性,并将在不久的将来开源。