OpenAI的GPT-5.2获得速度提升且不加价

OpenAI实现更快AI响应且不增加费用

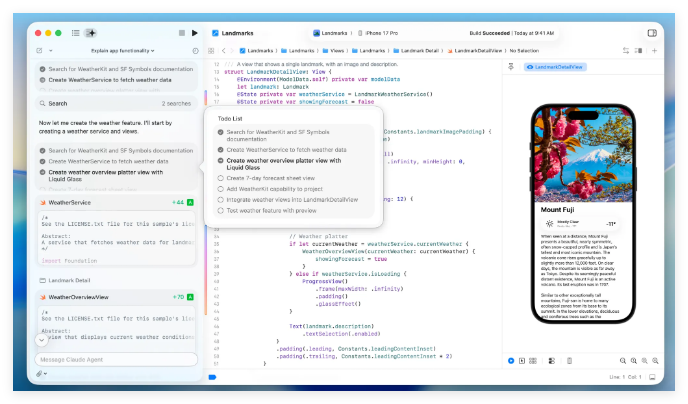

OpenAI在全球开发者的一片欢呼声中,显著提升了其旗舰产品GPT-5.2模型的速度,同时维持现有定价。最新优化使标准模型及其专业编程版本GPT-5.2-Codex的响应速度最高提升40%。

速度提升的背后

性能飞跃源自OpenAI推理堆栈(处理用户查询的系统)的精炼改进。有趣的是,这些改进并未涉及改变核心AI架构或用新数据重新训练模型。相反,工程师们优化了现有模型处理请求的方式。

"这就像调校高性能引擎,"一位熟悉此次更新的开发者解释道,"引擎盖下仍是同样强大的AI,只是在你踩油门时反应更快了。"

实际影响

此次速度升级对以下方面尤为宝贵:

- 编程工作流:开发周期中的迭代更快

- 交互式应用:与AI助手的对话感觉更自然

- 企业系统:更顺畅地融入业务流程

早期采用者报告在日常使用中感受到了明显差异。"我们的调试会话现在感觉像是真正的对话,而不是等待游戏,"硅谷一家初创公司的软件工程师Julia Chen分享道。

改进不涨价

最令人惊讶的是什么?这些性能提升并未给用户带来额外成本。尽管需要大量基础设施投资以实现更快的响应时间,OpenAI仍保持了现有的价格层级。

该公司继续快速迭代其模型系列,在尖端能力与实际可用性考量之间取得平衡。

关键点:

- 响应速度快40%:涵盖GPT-5.2和GPT-5.2-Codex模型

- 架构未变——相同的AI能力但延迟降低

- 特别受益于编码环境和交互式应用

- 价格稳定保持对开发者和企业的可及性