OpenAI 推迟发布 AI 代理,因安全问题担忧

OpenAI,作为人工智能发展的领军者,由于担心 '提示注入' 攻击,推迟了其备受期待的 AI 代理发布。尽管 Microsoft 和 Anthropic 等公司已经推出了自己的 AI 代理,OpenAI 仍专注于提升安全性,以避免这些攻击带来的风险。

什么是 '提示注入' 攻击?

'提示注入' 攻击发生在恶意行为者操控 AI 模型接受有害指令时。这可能导致意外后果,例如 AI 代理访问危险网站、忘记指令,甚至泄露敏感个人信息。在极端情况下,攻击者可能利用 AI 访问私人数据,包括电子邮件或信用卡信息。

AI 自主性带来的风险增加

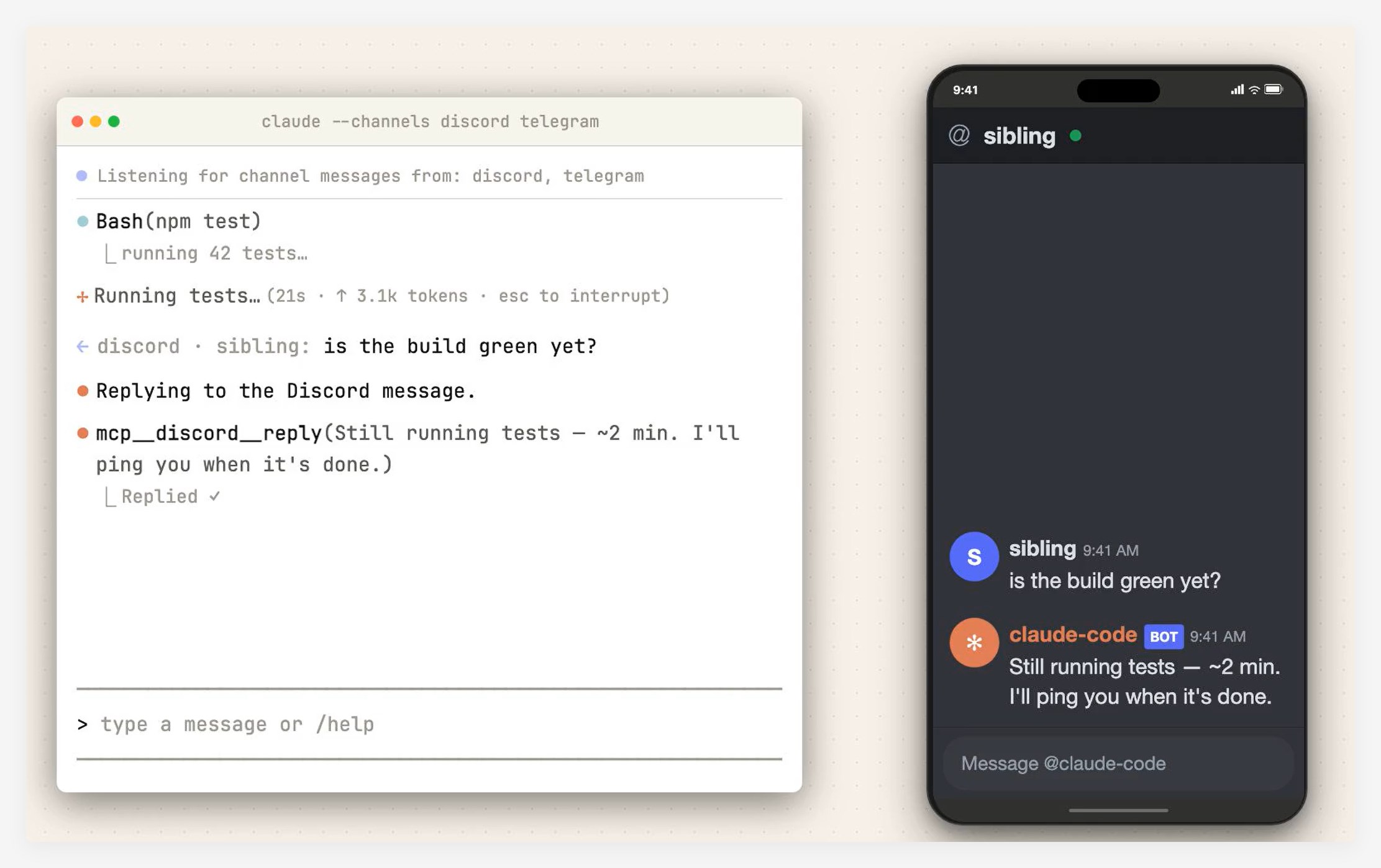

AI 代理能够自主与环境互动并执行任务,无需人工输入,这带来了重大的安全挑战。由于 AI 代理能够控制计算机并访问敏感数据,它们正日益成为网络攻击的目标。一位 OpenAI 员工强调,尽管像 ChatGPT 这样的语言模型天生容易受到攻击,但 AI 代理的 自主能力 使得这些风险更加严重。

AI 系统中的先前安全问题

提示注入 风险并非理论上的问题。去年,一位安全研究人员演示了如何操控 Microsoft's Copilot AI 泄露敏感的组织数据,包括电子邮件和财务记录。此外,研究人员还成功让 Copilot AI 以其他员工的风格撰写电子邮件,进一步暴露了系统的漏洞。

OpenAI 自己的 ChatGPT 也遇到了类似的安全问题。一位研究人员通过上传第三方文件,如 Word 文档,成功向系统注入虚假的 '记忆'。这些攻击类型突显了 OpenAI 在完善其 AI 代理的安全措施时所面临的漏洞。

OpenAI 对风险的回应

在 OpenAI 努力解决这些安全问题时,公司的做法让人惊讶,尤其是与 Anthropic 的处理方式相比。Anthropic,另一家 AI 开发公司,采取了相对放任的方式,仅建议开发者将 AI 代理与敏感数据隔离。相比之下,OpenAI 采取了更为谨慎的态度,强调严格的安全措施,以确保其 AI 代理的安全使用。

报告显示,OpenAI 可能在本月稍晚时推出其 AI 代理。然而,发布的时间表引发了关于公司是否能实施足够的安全防护来防范潜在攻击的疑问。

关键点

- OpenAI 因担心 '提示注入' 攻击可能危及用户数据,已推迟发布其 AI 代理。

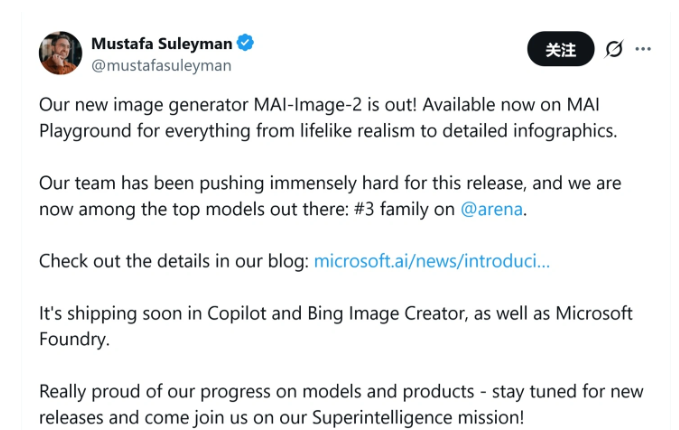

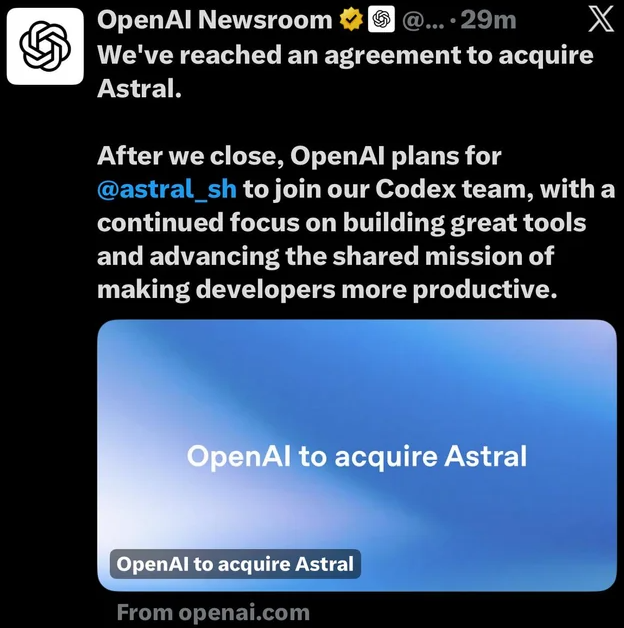

- 像 Microsoft 和 Anthropic 等公司已经发布了 AI 代理,但安全漏洞仍然是一个重大问题。

- OpenAI 正在努力加强其安全措施,以应对这些风险,旨在防止潜在的数据泄露。