介绍 HelloMeme:表达转移技术的飞跃

HelloMeme 介绍

最近,一个研究团队推出了一个突破性的 AI 框架,名为 HelloMeme,旨在促进高精度面部表情从场景中的一个人转移到另一个设置中的另一人的转移。

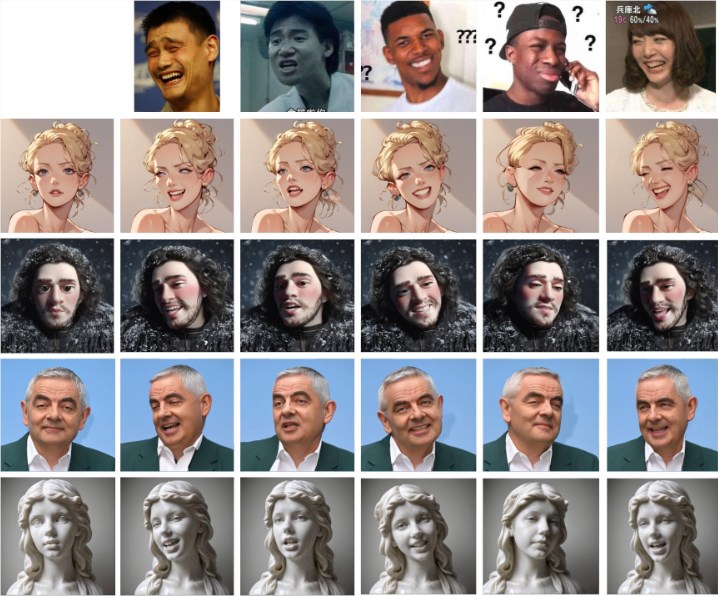

如附带图像所示,用户可以输入一个表情图像(第一行),允许将详细的面部表情转移到其他不同人的图像中。

独特的网络结构

HelloMeme 的核心功能基于其 独特的网络结构。该框架可以从驱动视频的每一帧中提取特征,然后通过 HMControlModule 进行处理。该工作流程能够生成流畅的视频影像。然而,初始输出在帧与帧之间出现了闪烁问题,影响了整体观看体验。为了应对这一问题,团队引入了 Animatediff 模块,该模块提高了视频的连续性,虽然稍微牺牲了保真度。

为了解决这一保真度问题,研究人员进一步优化了 Animatediff 模块,最终实现了改进的视频连续性与高质量图像输出之间的平衡。

增强的视频编辑能力

除了其主要功能外,HelloMeme 框架还提供 强大的面部表情编辑支持。通过整合 ARKit Face Blendshapes,用户可以轻松控制生成视频中角色的面部表情。这种能力显著丰富了视频内容的情感深度,使创作者能够有效地制作传达特定情感和表情的视频。

技术兼容性

从技术角度来看,HelloMeme 采用基于 SD1.5 的 热插拔适配器设计。该设计的主要优点在于,它保留了 T2I(文本到图像) 模型的泛化能力,确保在 SD1.5 框架上开发的任何风格化模型都可以轻松与 HelloMeme 集成。此功能为各种创意应用打开了众多可能性。

研究团队还发现,整合 HMReferenceModule 显著提高了视频生成过程中的保真度。这一进展使得可以以更少的采样步骤生成高质量视频,从而提高了生成效率,为实时视频创作铺平了道路。

比较分析

与其他方法的比较分析表明,HelloMeme 的表情转移能力产生的结果更自然,与原始表情的对齐程度更高,从而增强了整体的观众体验。

关键点

- HelloMeme 通过其独特的网络结构和 Animatediff 模块实现在视频生成中既流畅又高图像质量。

- 该框架支持 ARKit Face Blendshapes,让用户灵活地控制角色面部表情,丰富视频内容。

- 它采用 热插拔适配器设计,确保与其他基于 SD1.5 的模型兼容,为各种创作提供更大的灵活性。