Hugging Face推出SmolLM3:小巧精悍的AI新星

Hugging Face发布新一代紧凑型AI模型SmolLM3

2025年7月9日 - 在高效AI系统的重大进展中,Hugging Face正式发布了SmolLM3,这款最新的开源语言模型以30亿参数的紧凑体积实现了突破性能力。

小身材大能量

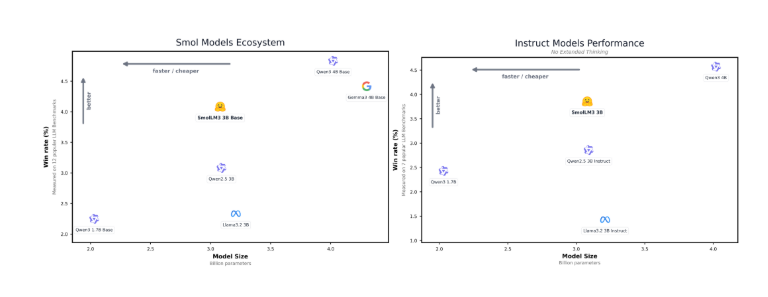

与同类开源模型如Llama-3.2-3B和Qwen2.5-3B相比,新模型展现出更卓越的性能,同时支持惊人的128K标记上下文窗口。这种扩展的记忆容量使得跨英语、法语、西班牙语和德语等多语言的连贯长文本处理成为可能。

创新的双模式架构

SmolLM3引入了新颖的双推理系统:

- 深度思考模式: 适用于需要密集计算的复杂分析任务

- 标准模式: 在深度非关键场景下提供更快响应

这种灵活架构使用户能根据具体应用需求优化性能。

开放式开发理念

秉承Hugging Face对开放AI开发的承诺,公司公布了:

- 完整架构规范

- 数据混合方法学

- 详细训练流程

该模型采用先进的transformer解码器架构,在SmolLM2设计基础上融合了Llama的关键改进。技术增强包括:

- 分组查询注意力机制

- 文档级掩码技术

- 优化的长上下文训练协议

训练流程与技术规格

模型通过分布式计算进行了为期24天的训练,配置如下:

| 参数 | 数值 |

|---|

三阶段训练方案战略性地结合了:

- 使用网络、数学和代码数据的通用能力构建阶段

- 通过专业数学/代码数据集强化的质量聚焦阶段

- 为推理优化的高级采样阶段

可用性与未来潜力

基础模型和指令调优变体现已登陆Hugging Face平台:

行业分析师预测此次发布将加速从教育到企业解决方案等各领域的高效AI应用开发。

核心亮点:

- 小巧强大: 30亿参数实现超越更大模型的性能

- 扩展上下文: 128K标记处理容量

- 双模切换: 针对不同需求的灵活推理方式

- 完全透明: 开放架构促进社区创新

- 多语种支持: 精通主要欧洲语言