华为Ascend模型无需GPU即可在数秒内解决复杂数学问题

华为以最新创新成果震撼AI行业——其大规模模型无需GPU便能在数秒内攻克复杂数学问题。采用混合专家(MoE)架构、拥有近万亿参数的"Ascend + Pangu Ultra MoE"系统,近日以两秒解出高等数学题的表现展示了其强大能力。

计算效率的飞跃

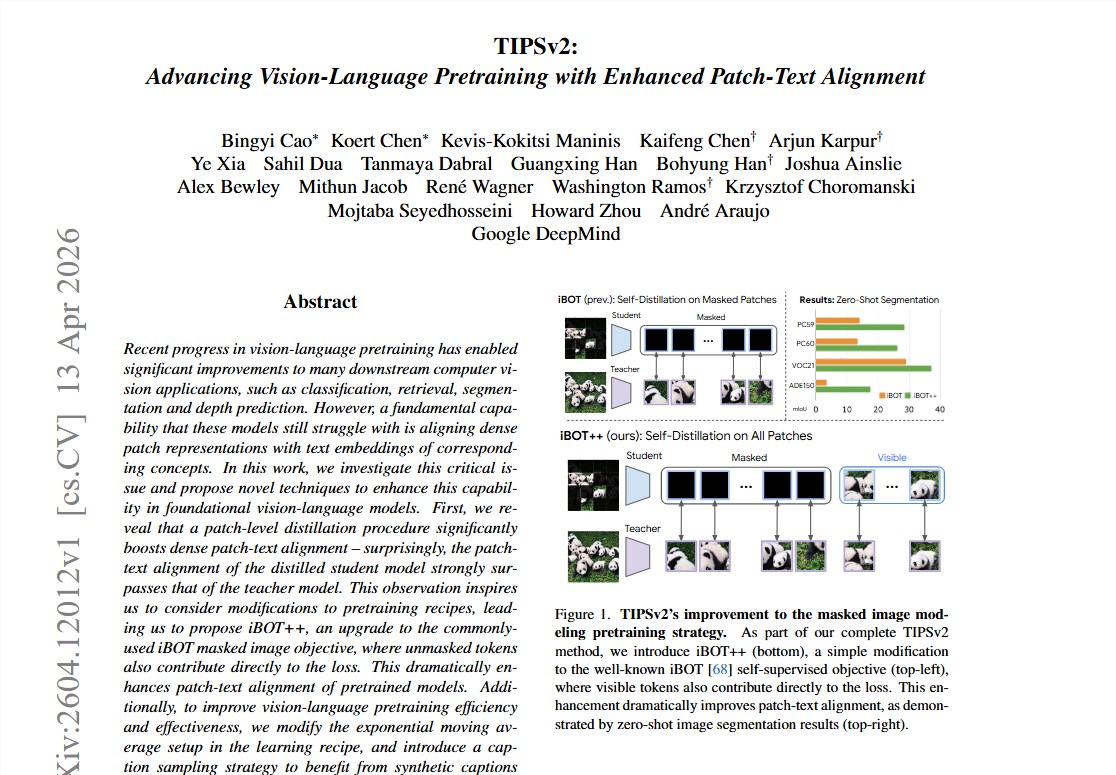

这一突破源于华为对并行策略与计算通信的优化能力,显著提升了集群训练效率。根据公司技术报告,工程师们通过在CloudMatrix384超级节点上改进通信机制与负载均衡策略实现这一目标。这些优化几乎消除了专家并行通信开销,同时确保了计算负载均衡。

单节点性能的倍增

除集群级优化外,华为还着力提升单节点计算能力。通过优化训练算子执行,团队将微批次规模扩大一倍,并解决了算子分布的低效问题。这意味着系统能用现有硬件处理更复杂任务,减少对GPU等外部组件的依赖。

对AI发展的意义

这些进步不仅惠及华为——更为全行业更高效训练大规模AI模型铺平道路。随着处理速度提升和硬件限制减少,研究人员与开发者有望在科学计算、自然语言处理和自主系统等领域加速创新。

这是否标志着AI训练将转向不依赖GPU?华为的进展表明这不仅可能,而且正在成为现实。

关键要点

- 华为Ascend模型无需GPU即可在两秒内解决高等数学问题

- 并行策略与负载均衡优化使通信开销趋近于零

- 单节点性能改进使微批次规模翻倍

- 该突破可能减少大规模AI训练对GPU的依赖