谷歌新AI突破:让计算机像人类一样观察

AI视觉的盲区

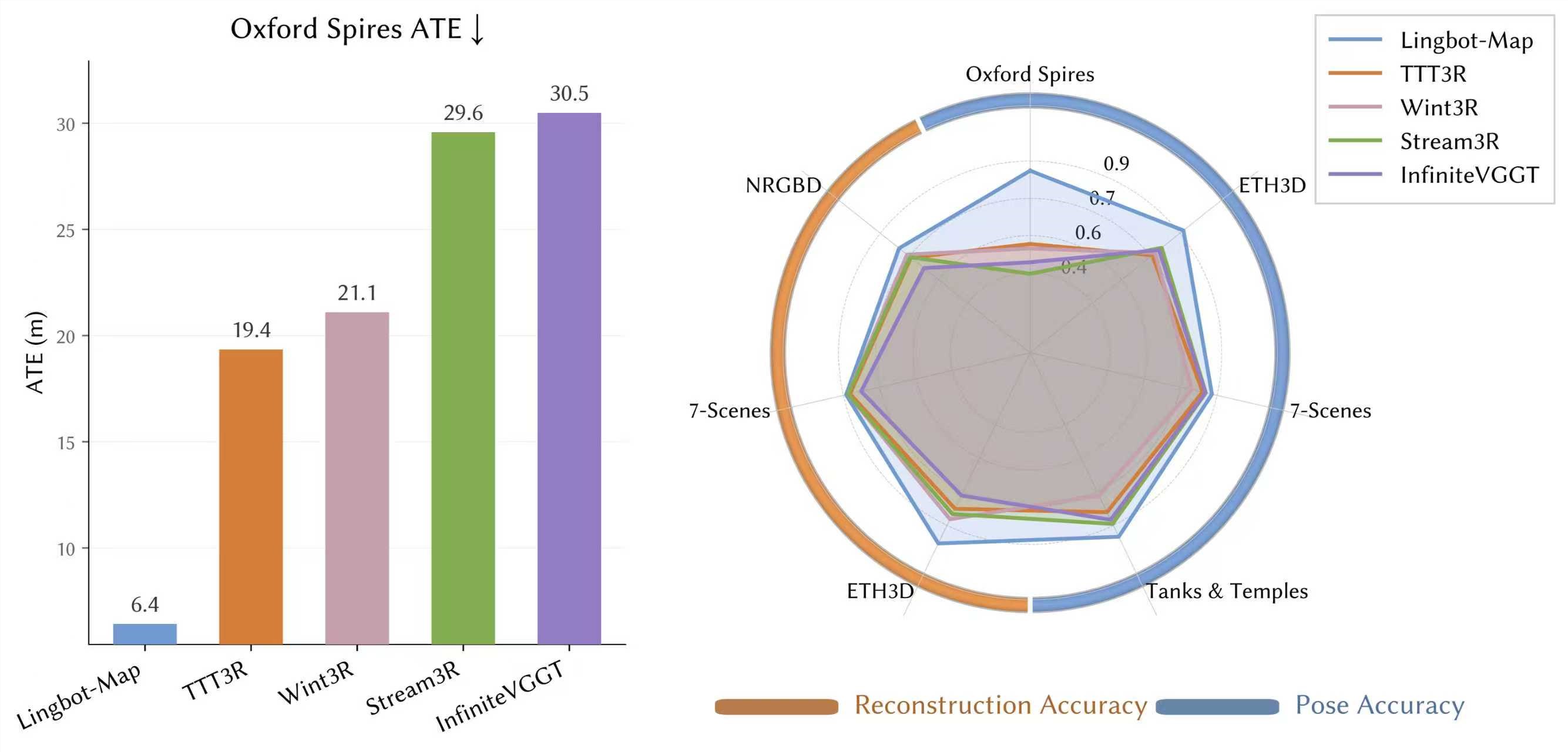

让大多数AI系统描述图片内容时,它们能给出优美的回答。但若提出更棘手的问题,比如"熊猫的左后腿在哪里?",它们的信心就会动摇。这不是单个模型的缺陷——而是整个视觉AI领域的根本局限。计算机擅长整体理解,却在精确定位方面表现欠佳。

TIPSv2背后的三项创新

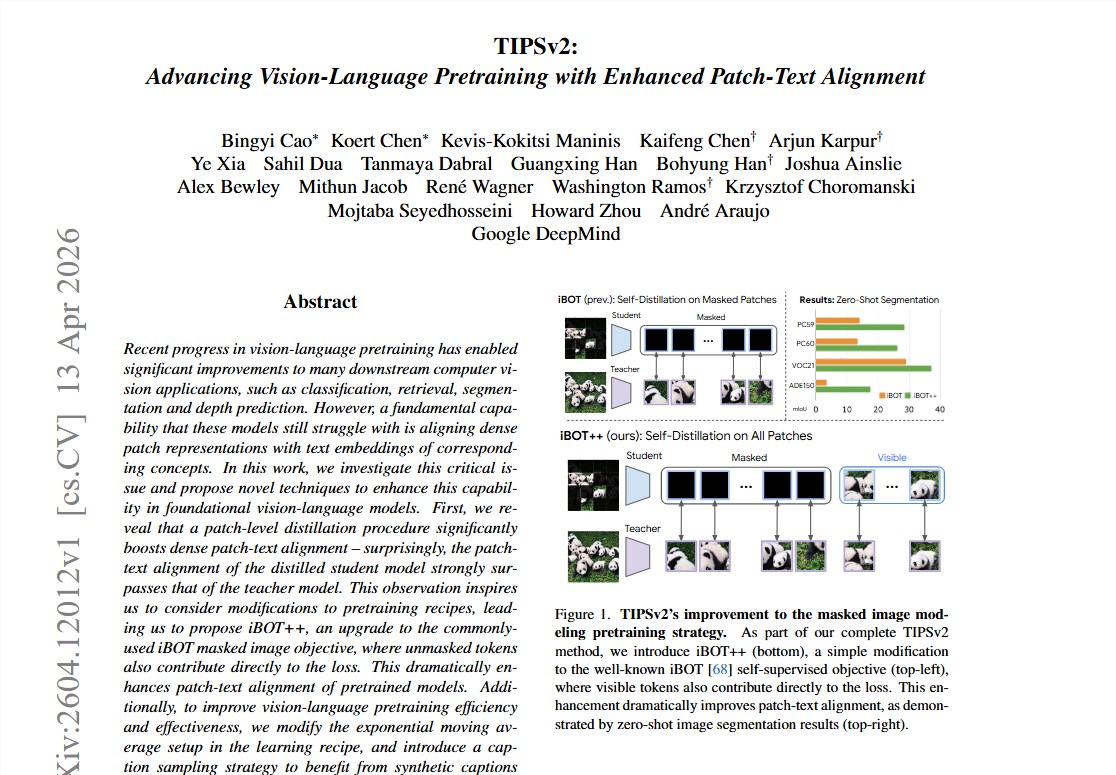

谷歌DeepMind研究团队有个意外发现:在详细图像分析中,小型AI模型有时反而优于大型模型。这一反直觉的发现催生了TIPSv2,它结合了三个关键技术突破:

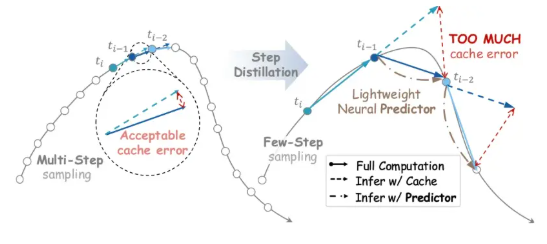

1. '完整教科书'学习法(iBOT++) 传统AI训练就像用缺失一半的拼图做练习。新的iBOT++方法强制系统学习每个图像细节,如同研读整本教科书而非随机节选。仅这一改变就将分割准确率提升了14%以上。

2. 更精简高效的训练(Head-only EMA) 先前方法需要同时维护两个重型模型——好比背着双份行囊登山。TIPSv2的巧妙修改只需保留一个完整模型,同时单独高效训练最终"决策"层,在保持性能的同时减少了42%的计算需求。

3. 多层次学习 想象只用儿童读物或仅凭博士论文来教学。TIPSv2通过混合简单标注、适度描述和Gemini生成的详细分析来避免这两种极端,让AI始终接受恰到好处的挑战。

实际应用价值

测试结果不言自明。在20项基准测试中,TIPSv2在零样本分割方面树立了新标准,同时在图像检索和分类任务上超越了更大模型。即使是纯视觉任务也显示出显著改进。

最令人振奋的是团队决定将这项技术开源。从解读X光片的放射科医师到开发自动驾驶汽车的工程师,依赖精确图像理解的专业人士如今都能使用前沿工具。

关键亮点:

- 解决AI"宏观与细节"的两难困境

- 结合三种新技术实现全面学习

- 训练效率比之前方法提高42%

- 多项基准测试超越更大模型

- 完全开源便于实际应用