DeepSeek-V4震撼登场:AI模型突破百万词记忆壁垒

DeepSeek-V4携革命性记忆容量重磅发布

人工智能刚刚迎来记忆能力的重大升级。DeepSeek新发布的V4系列模型通过支持高达百万词的上下文处理——相当于约十部长篇小说——同时保持各项任务的卓越表现,彻底打破了先前的能力边界。

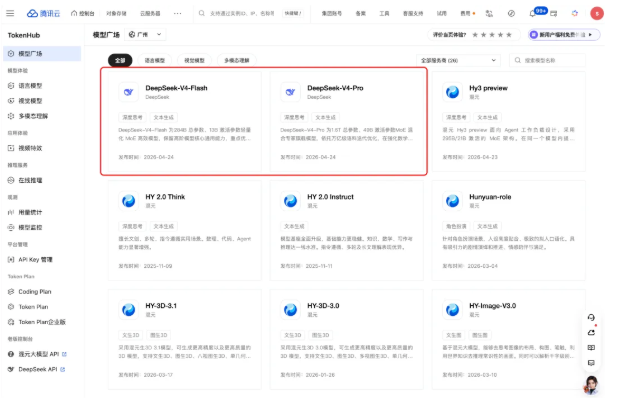

双模型架构,同一技术突破

V4系列针对不同需求推出两个版本:

- DeepSeek-V4-Pro:这款重量级选手(1.6T参数)性能对标顶尖闭源模型,尤其在编程任务中表现亮眼,其输出质量已接近Opus4.6等商业系统领先水平。技术评估显示其在数学和STEM相关挑战中超越所有公开可用的开源竞争对手。

- DeepSeek-V4-Flash:切勿被较小体型(284B参数)迷惑。虽然在常识储备上有所取舍,这款精简版模型在基础推理任务和智能体协作方面不逊于Pro版,同时提供更快速、更经济的API服务。

核心技术:智能注意力机制

实现这些突破的关键在于DSA稀疏注意力机制。传统AI模型处理长文档时需要消耗指数级增长的计算资源,而DeepSeek的解决方案是在token层面采用巧妙的压缩技术,显著降低处理时间和内存占用。

"这不仅是创造纪录",一位熟悉该技术的研究人员解释,"更是为了让长上下文AI从研究演示走向日常实用场景"。

为智能体时代量身打造

基于现代AI使用习惯洞察,V4系列特别优化了与Claude Code、CodeBuddy等智能体系统的协作能力,用户可自由切换:

- 非思考模式:快速响应简单查询

- 思考模式:深度解决复杂问题

API甚至开放了reasoning_effort参数供开发者根据任务难度(如代码生成或文档分析等密集型应用)精细调节模型的思考强度。

获取方式

预览版已通过DeepSeek官方渠道开放体验,新版API正陆续更新。重要提示:旧版模型名称(deepseek-chat和deepseek-reasoner)将于2026年7月24日停用。

公司同时兑现了开源承诺:

- 模型文件发布于Hugging Face和Moba社区平台

- 详细技术报告已上传至Hugging Face代码库

此次发布具有里程碑意义——证明开源模型在长文本处理和智能体功能等关键领域不仅能与商业巨头抗衡,还能保持对所有人的开放性。

核心亮点:

- 百万词记忆成为DeepSeek服务标配

- Pro版性能比肩顶级闭源系统

- Flash版提供经济型替代方案

- DSA机制大幅降低长文本处理成本

- 智能体适配功能包含可调节思考强度