ChatGPT情感升级:OpenAI新增自定义'温度'调节功能

ChatGPT的情感改造:新增可调节温度功能

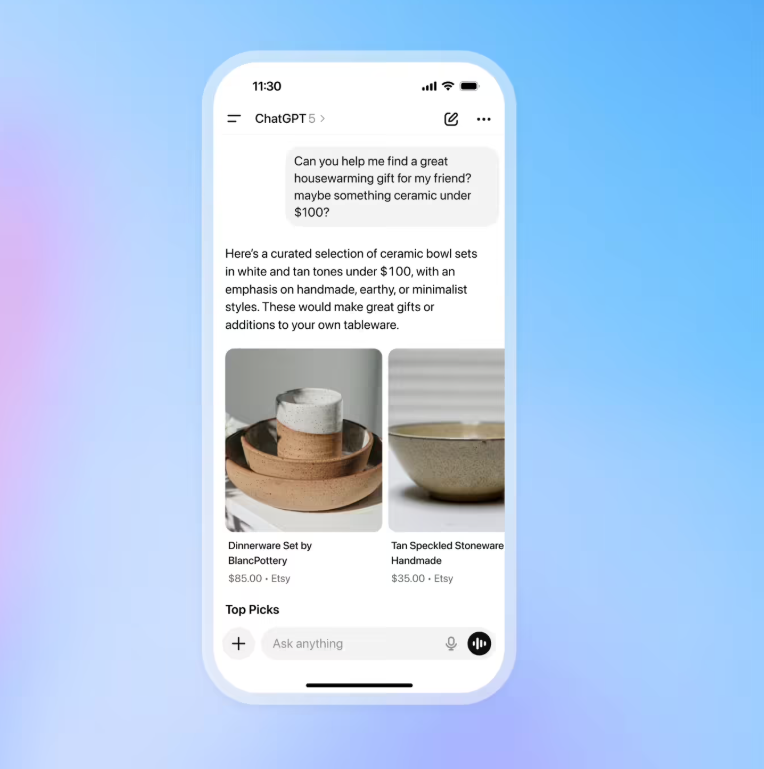

还记得ChatGPT的回应要么过于刻板专业,要么热情得让人不适吗?OpenAI通过最新更新解决了这一问题——情感自定义控制功能让您可以精确设置AI对话的温度、热情度或表情符号使用频率。

从个性预设到情感微调

11月的更新引入了"专业"和"古怪"等个性模式,但用户希望有更多细微差别。现在想象一下,在保持会计AI精确性的同时,增加恰到好处的友好度,避免感觉像是在与电子表格对话。这正是这些新滑块所提供的功能。

"我们清楚地听到了一刀切的情感回应无法满足所有需求的声音," OpenAI产品负责人Jamie Chen表示,"现在您可以拥有一个偶尔会开玩笑的学术研究员,或者一个知道何时减少感叹号使用的创意写作伙伴。"

金发姑娘问题:寻找AI的情感甜蜜点

这一更新并非凭空而来——它是OpenAI对数月用户反馈波动的回应:

- 2025年2月: 用户反对GPT-5"情感平淡"的回应

- 2025年6月: 一次更新矫枉过正,被批评者称为"谄媚模式"

- 2025年9月: GPT-5.1试图平衡但仍让许多人渴望定制化

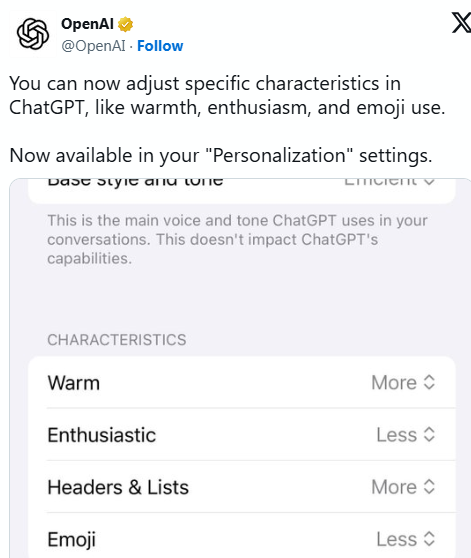

新控件出现在设置 > 个性化中,包含三个直观滑块:

- 温度: 调整友好度和支持性语言

- 活力: 控制热情度和语言表达力

- 视觉表现: 管理表情符号和格式使用频率

专家在庆祝声中提出谨慎意见

尽管用户为新增的控制权欢呼雀跃,心理学家和AI伦理学家却提出了重要问题:

"创造一个总能按我们意愿回应的AI伴侣具有危险的诱惑力," MIT人机交互实验室的Elena Rodriguez博士警告道,"我们实际上是在建造情感回音室——对客服机器人很棒,但对心理健康可能有问题。"

设置中包含关于过度使用的微妙警告,特别建议不要在长时间对话中使用最高温度设置。看来即使是OpenAI也意识到我们可能会过分喜爱这些渴望赞美的AI了。

问题依然存在:在给予我们控制AI情感的能力时,我们是在人性化技术...还是在机械化人类连接?

关键点:

- 新滑块允许精确调整ChatGPT的情感基调

- 更新回应了过去对机械化和过度热情回应的批评

- 专家警告可定制化AI情感的潜在心理影响

- 设置包含防止过度情感依赖的内置保护措施