寒武纪通过开源优化提升DeepSeek-V4性能

寒武纪实现DeepSeek-V4 AI模型首日支持

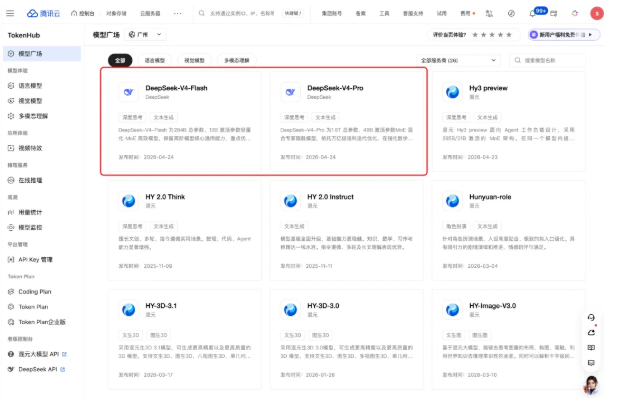

在中国AI生态系统的重要举措中,寒武纪宣布与DeepSeek新发布的开源模型系列实现完全"Day0"兼容。这家硬件专家已优化了紧凑型2850亿参数Flash版本和重量级1.6万亿参数Pro变体,使其能在寒武纪平台上从发布之日起就平稳运行。

技术突破

工程团队在适应DeepSeek-V4的稀疏注意力架构和压缩结构时面临独特挑战。他们的解决方案?一个名为Torch-MLU-Ops的自定义向量融合算子库,专门加速如Compressor模块等核心组件。

使用寒武纪的高性能编程语言BangC,开发者为关键操作创建了优化内核,包括:

- 稀疏注意力处理

- GroupGemm计算

- 五维混合并行策略(TP/PP/SP/DP/EP)

该实现完全支持vLLM框架内的低精度量化和PD分离部署,在保持严格延迟要求的同时显著提高了token吞吐量。

硬件优势

寒武纪的MLU处理器带来了专门的能力:

- 内存访问优化处理DeepSeek-V4的复杂索引模式

- 排序加速提高处理效率

- 高带宽互连最小化通信开销

这些特性在Prefill和Decode阶段特别有价值,有助于保持高推理利用率。

行业影响

DeepSeek-V4对计算平台提出了严峻挑战,因其具有:

- 百万token上下文窗口(100万字)

- 最先进的推理能力

- 海量参数数量

寒武纪能够在发布后立即提供全面支持,标志着两个重要发展:

- 国产硬件现在可以竞争支持超大型复杂AI模型

- 中国AI产业在软硬件协同设计方面已达到成熟水平

通过开源其适配代码,寒武纪邀请更广泛的社区参与优化这些尖端模型。

关键点:

- 即时兼容DeepSeek-V4的Flash(285B)和Pro(1.6T)版本

- 开源发布GitHub上的优化代码供社区访问

- 专门加速使用Torch-MLU-Ops库的稀疏注意力架构

- 硬件优势包括内存优化和高速互连

- 行业里程碑展示中国在AI基础设施方面的进步