本乔与勒昆辩论人工智能通往通用智能的道路

人工智能(AI)正处于一个变革的十字路口。随着技术的发展,关于其认知能力和与语言关系的关键讨论正在进行中。在这场辩论中,两位杰出的声音是图灵奖得主约书亚·本乔和扬·勒昆,他们对人工智能的未来及其实现人工通用智能(AGI)的潜力提供了不同的观点。

向推理与思维的转变

AI的发展传统上集中在语言模型上,但最近的进展正在推动AI能实现的界限。领先的公司现在专注于AI的推理和认知能力,这在OpenAI的o1模型中得到了体现。该模型在数学和编程等领域取得了显著的进展,这表明AI可以处理超越简单语言处理的复杂逻辑任务。

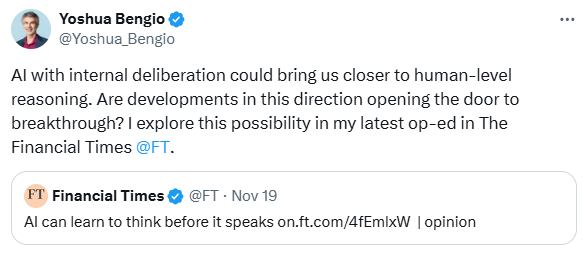

本乔在《金融时报》的最近一篇文章中争辩说,AI可能很快会达到一个转折点,在其能“说话”之前就能“思考”。他认为这可能代表着朝向AGI的一个关键步骤。历史上,AI与系统1认知相关联,指的是快速、直观的过程。相比之下,人类智能深深植根于系统2认知——缓慢、深思熟虑的推理。本乔认为,AI发展推理能力的能力可能会反映人类思维过程的演变。

语言在AI与人类思维中的角色

语言是否是思考的必需品是关于AI未来辩论的中心问题。勒昆,另一位图灵奖得主,质疑这一假设。根据MIT的研究,勒昆指出研究表明,人类在没有语言的情况下仍然可以思考。例如,患有全局性失语症的患者——其语言障碍严重——依然能够解决数学问题,理解因果关系,甚至创造艺术。这表明,思考可能比语言更为基本。

虽然勒昆承认语言对于社交互动和复杂推理等更高级认知功能很重要,但他强调语言并不是基本思维的前提。这一见解为AI开辟了新的可能性,提出了一个问题:AI能够发展出一种根本不同于人类认知的智能形式吗?

AI在新形式智能中的潜力

AI发展出一种独立于语言的智能形式的可能性挑战了传统的认知观念。随着如o1等AI模型的持续演变,它们显示出在不依赖人类语言结构的情况下解决复杂问题的能力。这些突破可能表明,AI可能会遵循一条独特的认知路径,与人类思维过程不同。

这种转变尤其重要,因为它提出了关于先进AI的伦理影响的新问题。随着AI系统在复杂推理方面变得越来越强大,它们欺骗和操纵人类的潜力也在增加。公司和研究人员必须在创新与谨慎之间保持平衡,以确保AI的负责任发展。

AI的未来:推理与语言的平衡

AI的发展处于一个关键时刻。尽管语言模型的探索已经取得了令人瞩目的成果,但追求推理能力可能是下一个重大飞跃。然而,与其将这两条路径视为互相排斥的,AI的未来可能在于将语言与推理这两个方面整合到一个连贯的框架中,以新的方式反映人类智能。

要点

- 图灵奖得主约书亚·本乔和扬·勒昆对语言在AI中的作用及其潜在的AGI产生不同看法。

- 本乔认为,AI可能很快会“思考”而不是“说话”,标志着推理能力的转变。

- 基于对严重语言障碍患者的研究,勒昆强调语言可能不是思考的必需品。

- 随着AI的演变,其推理和思维的能力可能导致新的智能形式,这与人类认知不同。

- 高级AI的伦理挑战,包括欺骗风险,必须与技术进步一同解决。