苹果下一代Siri将于2026年搭载谷歌Gemini AI运行

苹果押注谷歌AI重塑Siri未来

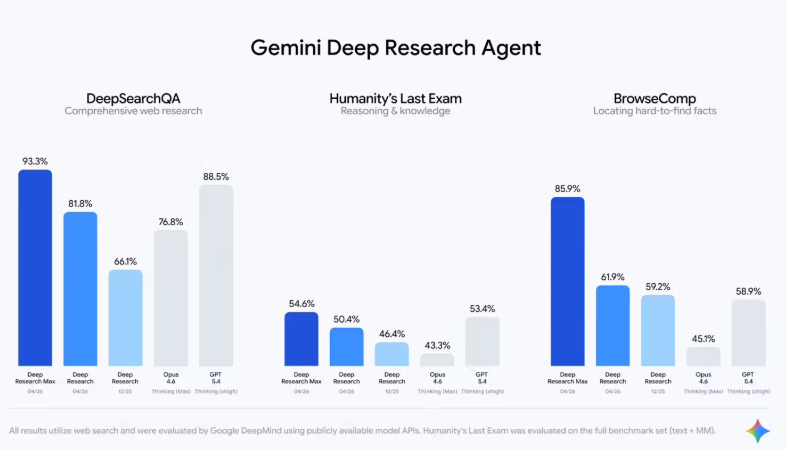

在今年Google Cloud Next大会上,科技界首次官方确认了众人已久的猜测:苹果正联手谷歌,利用这家搜索巨头的强大Gemini AI模型重塑Siri。这款定于2026年发布的新一代语音助手,终于有望实现长期使Siri落后于Alexa和Google Assistant等竞争对手的情境理解能力。

为何此次合作至关重要

多年来,苹果粉丝目睹Siri在AI竞赛中逐渐落后。当竞争对手能跨应用处理复杂请求时,Siri仍常回复"我无法协助处理该请求"。如今通过将Gemini的多模态处理能力与苹果专有云架构结合,两家公司旨在缩小这一差距,同时保持苹果严格的隐私标准。

"这不仅关乎让Siri更聪明,"行业分析师Maria Chen解释道,"更意味着苹果承认无法独自赢得AI战争。与谷歌合作让他们能即时获取尖端技术,同时继续开发自有解决方案。"

技术突破

本次合作攻克了两大难题:

- 设备端智能:通过据称每年10亿美元的投资,苹果已调整Gemini以高效运行于iPhone和iPad上,且不影响性能或电池续航

- 隐私保护:用户请求仍尽可能在本地处理,仅最复杂任务交由云计算处理——全程端到端加密

这种混合方案与苹果在WWDC 2024上预览的"屏幕感知"愿景相呼应,但当时因技术限制未能完全实现。

用户2026年可期待的功能

新版Siri不仅能更好理解指令——还将根据以下因素预判需求:

- 当前屏幕内容

- 用户历史行为模式

- 对话上下文

- 跨应用工作流(终于实现!)

试想当编辑图片时询问"如何让这张照片更出彩?",获得的将是相关编辑建议而非网页搜索结果。

行业影响

此次合作重塑了竞争格局:

- 谷歌巩固其作为AI基础设施领导者的地位

- 苹果立即获得顶级AI能力支持

- 整个智能手机市场向真正的"意图理解"迈进一大步

2026年的发布窗口为双方留出完善技术的时间,同时让消费者为可能是Siri有史以来最重要的升级做好准备。

关键要点:

- 颠覆性合作:苹果选择联手谷歌而非自主开发AI

- 隐私优先方案:专为设备端处理优化的Gemini

- 情境为王:新版Siri理解屏幕内容与用户历史

- 2026年目标:重大升级将随当年iOS/iPadOS更新推出